درع ذكي.. OpenAI تطلق ميزة لإنقاذ الأرواح عبر ChatGPT

ChatGPT

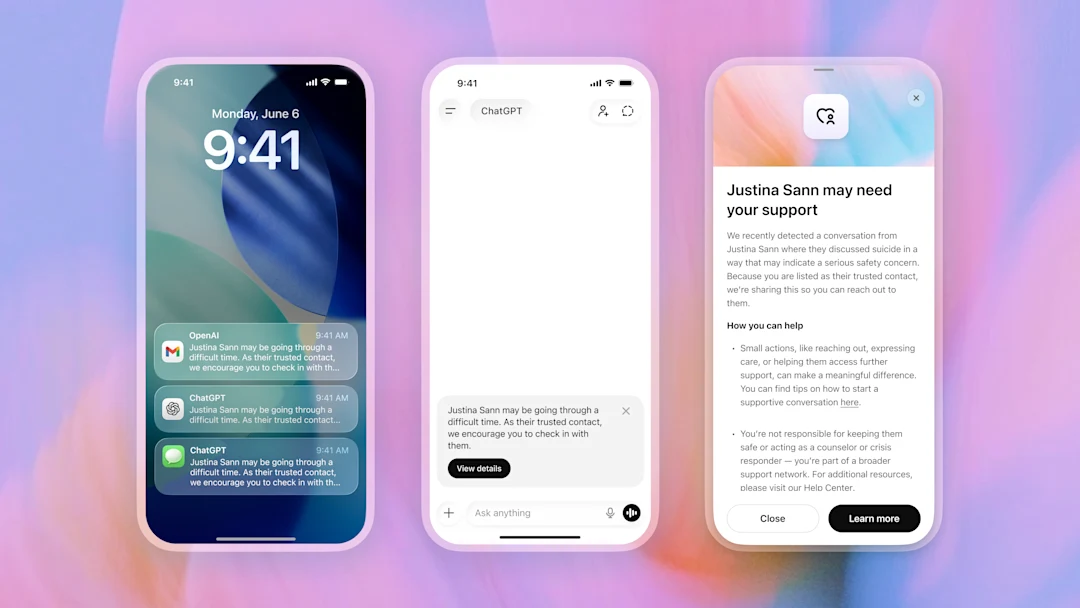

أطلقت شركة OpenAI رسمياً ميزة "Trusted Contact" الجديدة كلياً، والتي تهدف إلى توفير طبقة حماية إضافية لمستخدمي ChatGPT الذين قد يمرون بأزمات نفسية حادة، حيث تتيح الميزة للمستخدم تعيين جهة اتصال موثوقة من البالغين لتلقي إشعار فوري في الحالات الطارئة.

أوضح المحلل Michael Allison أن هذه الخطوة تأتي استجابةً للمخاوف المتزايدة بشأن الصحة العقلية في عصر الذكاء الاصطناعي، إذ سيعمل النظام على رصد المحادثات التي تنحرف نحو إيذاء النفس أو الأزمات الوجودية العميقة، ليتدخل بشكل استباقي من خلال تنبيه الشخص المختار للمساعدة في احتواء الموقف.

تستهدف OpenAI من خلال هذا التحديث، الذي بدأ تدشينه في 7 مايو 2026، بناء جسر تواصل بين المستخدم وبيئته الاجتماعية الحقيقية، مع التأكيد على أن الميزة لا تمثل بديلاً عن الرعاية الطبية المهنية أو خدمات الطوارئ، بل هي أداة مساندة تشجع على الاتصال البشري في اللحظات الحرجة.

حماية المستخدم

يتطلب تفعيل الميزة اختيار شخص واحد بالغ يتجاوز عمره 18 عاماً، أو 19 عاماً في بعض الدول مثل كوريا الجنوبية، من خلال إعدادات التطبيق، ولا يشترط أن يمتلك الطرف الآخر حساباً على المنصة، حيث تتم عملية التنبيه بعد مراجعة دقيقة للمحتوى لضمان الخصوصية والتشخيص الصحيح للمخاطر.

تخضع كل حالة لرصد بشري مدرب قبل إرسال أي إشعار لجهة الاتصال الموثوقة، ويسعى فريق السلامة في الشركة للانتهاء من المراجعة في أقل من ساعة واحدة، لضمان استجابة سريعة وفعالة تحاكي التدخلات الإنسانية المطلوبة في حالات الأزمات العقلية والنفسية المعقدة.

تواجه شركات التقنية ضغوطاً متزايدة حول طبيعة التفاعل العاطفي بين الروبوتات والمستخدمين الضعفاء، خاصة بعد ظهور مصطلحات مثل "ذهان الذكاء الاصطناعي" في النقاشات العامة، مما دفع الشركات للبحث عن توازن دقيق بين تقديم تجربة محادثة مقنعة والحفاظ على حدود السلامة النفسية.

رقابة بشرية

تدرك الشركة جيداً أن بعض المستخدمين قد يعتمدون على ChatGPT ككاتم أسرار أو معالج نفسي، وهو ما قد يؤدي إلى نتائج عكسية إذا تم تعزيز الأفكار الانهزامية، لذا صُمم النظام الجديد ليكون بمثابة صمام أمان يكسر دائرة العزلة الرقمية ويعيد المستخدم إلى دائرة الدعم الاجتماعي التقليدية.

يشير خبراء السلامة إلى أن الميزة ستتعامل بحذر شديد مع الحالات النادرة التي تتطلب تدخلاً فورياً، مع الحفاظ على توجيه المستخدمين دائماً للاتصال بالخطوط الساخنة للأزمات، لضمان عدم حدوث اعتماد كلي على الآلة في اتخاذ قرارات مصيرية تتعلق بالسلامة الشخصية والحياة.

تثير هذه الإجراءات الرقابية نقاشاً حول مدى تدخل الذكاء الاصطناعي في خصوصية الأفراد، إلا أن OpenAI تؤكد أن الهدف هو تقليل مخاطر الانتحار وإيذاء النفس، وذلك من خلال آلية تجمع بين خوارزميات التعلم العميق والتقييم البشري الواعي الذي يدرك سياق الكلام والمشاعر.

توازن معقد

تتوقع الأوساط التقنية أن تتبع شركات أخرى مثل Google وAnthropic هذا النهج في المستقبل القريب، لتجنب الملاحقات القانونية والانتقادات الأخلاقية المرتبطة بالتعلق العاطفي بالآلات، خاصة في ظل تزايد التقارير التي تتحدث عن مستخدمين يعانون من اضطرابات نفسية بسبب تفاعلاتهم الرقمية.

يعتقد المدافعون عن الخصوصية أن زيادة "الرقابة الأبوية" على المستخدمين قد تدفع البعض للبحث عن طرق للالتفاف على خوارزميات المنع، لكن الواقع يفرض وجود مثل هذه الأدوات في ظل تطور قدرة الذكاء الاصطناعي على الإقناع والتأثير العاطفي العميق على البشر.

تستمر OpenAI في تطوير طبقات الحماية لمنع وقوع حوادث مأساوية مرتبطة باستخدام ChatGPT، مؤكدة أن النظام ليس كاملاً ولن يعكس دائماً الحقيقة المطلقة لما يمر به الشخص، لكن المحاولة لإنقاذ حياة واحدة تبرر بناء هذه الأنظمة المعقدة والالتزام بتطويرها الدائم عالمياً.

أخبار ذات صلة

الأكثر مشاهدة

أحدث الموبايلات

-

Apple iPhone 13 Pro Max

-

Xiaomi Redmi Note 11

-

Samsung Galaxy A52s

-

OPPO Reno6 Pro 5G

-

realme GT2 Pro

-

vivo Y19

-

Honor 50 Pro

-

Huawei Nova 9

-

Nokia 8.3 5G

هل يتراجع عدد عملاء CIB خلال الفترة المقبلة بعد زيادة أسعار رسوم التحويل والخدمات؟

-

نعم

-

لا

-

غير مهتم

أكثر الكلمات انتشاراً